【2026年5月最新】Microsoft Copilotの情報漏えいリスクとは?AIツール別セキュリティ対策を完全解説

この記事の内容

「Microsoft Copilotを導入したいけど、情報漏えいが心配で踏み切れない」——この記事にたどり着いたあなたは、おそらくそう感じているはずです。

実際、AIツールにおける情報漏えいリスクは使い方とプラン選択で大きく変わります。Copilot、ChatGPT、Claude、Geminiなど主要AIツールはそれぞれ異なるデータ保護ポリシーを持っており、「どのツールを、どのプランで、どのように使うか」によってリスクの大きさは天と地ほどの差が出ます。

この記事では、Microsoft Copilotを中心に主要AIツール4社のセキュリティポリシーを徹底比較し、企業が取るべき具体的な対策まで解説します。「AIを使いたいが機密情報が怖い」という経営者・情報システム担当者の方に、リスクを正しく理解して判断していただくための完全ガイドです。

この記事を最後まで読むと、次の7つが明確になります。

01 RISK OVERVIEW Microsoft Copilotの情報漏えいリスクはどこにあるのか まず「何が漏れるのか」「どこから漏れるのか」を正確に理解する

Microsoft Copilotを使ったときに「情報漏えい」が起きるとしたら、具体的にどのような経路で、どんなデータが外部に出てしまうのか。まずはリスクの全体像を正確に把握することから始めましょう。

📚 用語解説

情報漏えい(データリーク):企業や個人が保有する機密情報・個人情報が、意図しない形で外部に流出すること。AIツールの場合、入力したデータがAIの学習データとして取り込まれ、他のユーザーへの応答に含まれてしまうリスクが代表的な懸念です。

1-1. AIツールにおける情報漏えいの3つの経路

AIツールを業務で使う場合、情報が外部に出る可能性のある経路は大きく3つあります。

| 経路 | リスクレベル | 概要 |

|---|---|---|

| AI学習データへの取り込み | 最も危険 | 入力したデータがAIモデルの学習に使われ、他ユーザーへの応答に含まれる可能性 |

| サーバー上でのデータ保存 | 中程度 | 入力データがクラウドサーバーに保存され、不正アクセスやバグで流出する可能性 |

| 通信経路での傍受 | 低い | HTTPS暗号化が標準のため、通信中の傍受リスクは現在ほぼゼロ |

多くの経営者が最も恐れているのは1つ目の「AI学習データへの取り込み」です。「自社の機密データがAIに学習されて、競合他社がAIに質問したときに自社情報が出てきてしまう」——このシナリオは確かに理論上は起こり得ます。ただし、後述するようにプランと設定次第で完全に防げるリスクでもあります。

AIツール自体のセキュリティよりも、実は最も多い情報漏えいの原因は社員が無料版のAIに機密データを入力してしまうヒューマンエラーです。ツール側の対策と並行して、社員のリテラシー教育が不可欠です。

1-2. Copilotで「漏れる可能性がある」データの種類

Microsoft Copilotに入力する業務データの中で、漏えいした場合にダメージが大きいものを整理します。

1-3. 「漏えい」と「学習への利用」は別の問題

ここで重要な区別があります。「データが漏えいする」ことと「データがAI学習に使われる」ことは、似ているようで別の問題です。

| 問題 | 内容 | 防げるか |

|---|---|---|

| 学習への利用 | 入力データがモデルの訓練に使われ、間接的に他者の応答に影響 | プラン選択・設定で防止可能 |

| 直接的な漏えい | 入力データがそのまま第三者に表示される | 通常は起きない(バグを除く) |

| サーバー侵害 | ハッキングやバグでサーバー上のデータが流出 | ベンダーのセキュリティ体制に依存 |

つまり、「学習に使われない」プランを選べば、最大のリスク経路は封じられるということです。次の章では、Copilotのプラン別にこのリスクがどう変わるかを見ていきます。

📚 用語解説

NDA(秘密保持契約):Non-Disclosure Agreementの略。取引先との間で交わす、情報を第三者に漏らさないことを約束する契約。AIツールに入力したデータがNDA対象の場合、学習に使われると契約違反になる可能性があります。

データを

AIに入力

AIが処理

応答を生成

学習に使用

リスクあり

破棄される

安全

上の図のStep 3a(学習に使われる)とStep 3b(破棄される)の分岐が、プラン選択で切り替わるポイントです。

02 PLAN COMPARISON プラン別に見るCopilotのデータ保護レベル 無料版・Pro・for Microsoft 365で安全性が根本的に違う

Microsoft Copilotは、プランによってデータの取り扱いポリシーが根本的に異なります。ここを正しく理解しないまま導入すると、「安全だと思っていたのに実は学習に使われていた」という事態が起こり得ます。

2-1. 無料版Copilot:入力データが学習に使われるリスクあり

無料版のMicrosoft Copilot(旧Bing Chat)は、入力したデータがAIモデルの改善・学習に使われる可能性があるプランです。Microsoftの利用規約上、無料版ユーザーの入力データは「サービスの品質向上」に活用される旨が明記されています。

無料版Copilotに社内の機密情報・顧客データ・ソースコードを入力することは、事実上「Microsoftに学習データとして提供している」のと同義です。業務利用する場合は、必ず有料の組織向けプランを使ってください。

具体的な注意点として、無料版Copilotでは以下の保護が適用されません。

2-2. Copilot Pro(月額3,200円):個人向け有料だが学習リスクは残る

Copilot Pro(月額3,200円)は、GPT-4ベースの高速処理やMicrosoft 365との連携が強化された個人向け有料プランです。しかし、セキュリティ面では注意が必要です。

Copilot Proは個人契約であるため、Commercial Data Protection(商用データ保護)が自動適用されるわけではありません。法人のEntra ID(旧Azure AD)に紐づかない個人アカウントでの利用の場合、無料版と同様にデータが学習に使われるリスクが残ります。

📚 用語解説

Commercial Data Protection(商用データ保護):Microsoftが法人向けCopilotプランで提供するデータ保護機能。入力データがAIの学習に使われないこと、データが暗号化されること、Microsoftの従業員がアクセスできないことなどが保証されます。無料版・個人版には適用されません。

Copilot Proは「高速処理・高品質な応答」を得るためのプランであり、「セキュリティが強化される」プランではありません。セキュリティを求めるなら、次に紹介する組織向けプランへの移行が必須です。

2-3. Copilot for Microsoft 365(月額4,497円):商用データ保護が適用

Copilot for Microsoft 365(月額4,497円/ユーザー)は、商用データ保護が全面適用される組織向けプランです。このプランでは以下の保護が保証されます。

📚 用語解説

Zero Trust(ゼロトラスト):「誰も信頼しない」を前提としたセキュリティモデル。社内ネットワークからのアクセスでも、毎回ID認証とデバイス検証を行います。従来の「社内は安全、社外は危険」という境界型セキュリティの限界を克服する考え方です。

つまり、企業がCopilotを安全に使いたいなら、Copilot for Microsoft 365一択です。無料版やProで業務データを扱うのは、セキュリティポリシー上認められるべきではありません。

2-4. プラン別セキュリティ比較まとめ

| 項目 | 無料版 | Copilot Pro | for Microsoft 365 |

|---|---|---|---|

| 月額料金 | $0 | 約3,200円 | 約4,497円 |

| AI学習への利用 | 使われる可能性あり | リスク残存 | 使われない(契約保証) |

| 商用データ保護 | 非適用 | 非適用(個人契約時) | 適用 |

| データ暗号化 | 基本的 | 基本的 | 転送時+保存時の完全暗号化 |

| 監査ログ | なし | なし | あり |

| DLP連携 | なし | なし | あり |

| 業務利用の推奨度 | 非推奨 | 個人に限定 | 企業利用はこのプラン |

📚 用語解説

DLP(Data Loss Prevention):情報漏えい防止の仕組み。機密データ(クレジットカード番号、マイナンバー等)がメール・チャット・AIツールを通じて社外に送信されそうになると、自動でブロックまたは警告する機能です。

03 REAL INCIDENTS 実際に起きたAIツール経由の情報漏えい事例 他社の失敗から学び、同じ過ちを繰り返さない

「情報漏えいなんて大企業の話でしょ」と思う方もいるかもしれません。しかし、実際にAIツール経由の情報漏えい事例は複数報告されており、そのほとんどが「社員の不注意」が原因です。ここでは代表的な3つの事例を紹介します。

3-1. サムスン電子 ── ChatGPTへのソースコード流出(2023年)

2023年、韓国のサムスン電子が社内でChatGPTの利用を許可したところ、わずか20日間で3件の機密データ流出が発生しました。

いずれも社員が「便利だから」と、業務効率化のために良かれと思って行った行為です。しかし、当時のChatGPT(無料版)は入力データをAI学習に使用するポリシーだったため、事実上、サムスン電子の機密ソースコードがOpenAIのサーバーに学習データとして取り込まれたことになります。

問題の本質はChatGPTのセキュリティ欠陥ではなく、「無料版AIに機密データを入力してもよいか」のルールが社内に存在しなかったことです。ツール側の安全性に関わらず、利用ルールの未整備は最大のリスクファクターです。

3-2. OpenAI ── ChatGPTの会話履歴・支払情報の表示バグ(2023年3月)

2023年3月、OpenAI自身のサービスで他のユーザーのチャット履歴のタイトルが一部ユーザーに表示されるバグが発生しました。さらに、同じバグによりChatGPT Plus加入者の氏名・メールアドレス・支払い先住所・クレジットカード下4桁も閲覧可能な状態になりました。

OpenAIはこのバグを9時間で修正し、影響範囲は全ユーザーの1.2%程度と発表しましたが、「AIベンダー側のバグで個人情報が流出する」という事態が現実に起きたことは、業界に大きな衝撃を与えました。

3-3. Microsoft ── Azure AIサービスでの38TBデータ露出(2023年9月)

2023年9月、Microsoftの研究チームがAI学習データをGitHub上で公開した際、Azure Storage上の38TB分の内部データが誤って公開状態になっていたことが発覚しました。公開されていたデータには、30,000件以上のTeamsメッセージ、Microsoftサービスのバックアップ、内部パスワードなどが含まれていました。

これはCopilot自体の脆弱性ではなく、AI研究チームの設定ミスによるクラウドストレージの公開事故です。しかし、「Microsoftでさえこのような事故が起きる」という事実は、自社のクラウドセキュリティを見直すきっかけになるはずです。

1. 無料版AIに機密データは絶対に入力しない

2. AIベンダー側のバグによる漏えいリスクもゼロではない

3. クラウドストレージの権限設定は定期的に監査する

04 SECURITY COMPARISON AIツール4社のセキュリティポリシー徹底比較 Copilot・ChatGPT・Claude・Geminiのデータ取扱いを横並びで整理

企業がAIツールを選定する際、最も重要な判断基準の一つが「入力データをどう扱うか」です。ここでは主要4ツールのセキュリティポリシーを横並びで比較します。

4-1. データ学習ポリシーの比較

| ツール | 無料版のデータ学習 | 有料版のデータ学習 | オプトアウト可否 |

|---|---|---|---|

| Microsoft Copilot | 学習に使われる可能性あり | for M365は学習に使わない | 無料版はオプトアウト不可 |

| ChatGPT (OpenAI) | デフォルトで学習に使用 | Team/Enterpriseは学習に使わない | API版・有料版は設定で停止可 |

| Claude (Anthropic) | 無料版でも基本的に学習に使わない | 全有料版で学習に使わない | そもそも学習に使わないポリシー |

| Gemini (Google) | 無料版は学習に使用 | Workspace連携版は学習に使わない | Google設定で一部制御可 |

この比較表で最も目を引くのはClaudeのポリシーです。Anthropicは、無料版・有料版を問わず「ユーザーの入力データをAIモデルの学習に使用しない」ことを明確に表明しています。他の3社が「有料版なら学習に使わない」という条件付きなのに対し、Claudeは全プランで一貫したポリシーを持っている点が際立ちます。

📚 用語解説

オプトアウト:「初期設定では適用されているが、ユーザーが意思表示することで除外してもらう」仕組み。AIの学習利用においては、「デフォルトで学習に使うが、設定を変えれば止められる」という場合に使われます。オプトアウトの手続きが面倒だと、実質的に多くのユーザーのデータが学習に使われ続けることになります。

4-2. セキュリティ認証・コンプライアンスの比較

| 項目 | Copilot (M365) | ChatGPT (Enterprise) | Claude | Gemini (Workspace) |

|---|---|---|---|---|

| SOC 2 Type II | 取得済み | 取得済み | 取得済み | 取得済み |

| ISO 27001 | 取得済み | 取得済み | 取得済み | 取得済み |

| GDPR対応 | 対応 | 対応 | 対応 | 対応 |

| HIPAA対応 | 対応(追加契約) | 対応(Enterprise) | 対応(Enterprise) | 対応(追加契約) |

| データリージョン選択 | 可能 | 可能(Enterprise) | 可能 | 可能 |

| 暗号化(転送時) | TLS 1.2+ | TLS 1.2+ | TLS 1.2+ | TLS 1.2+ |

| 暗号化(保存時) | AES-256 | AES-256 | AES-256 | AES-256 |

📚 用語解説

SOC 2 Type II:米国公認会計士協会(AICPA)が定めたセキュリティ認証の一つ。組織のセキュリティ管理体制が継続的に機能していることを第三者監査で確認した証明です。Type IIは「6ヶ月以上の運用実績」を検証しており、Type I(特定時点のみ)より信頼性が高いとされます。

セキュリティ認証の面では、4社ともほぼ同水準です。SOC 2 Type II、ISO 27001、GDPR対応など、主要な認証はいずれも取得済みです。つまり、差がつくのは認証の有無ではなく、「データを学習に使うかどうか」のポリシーの明確さです。

4-3. 法人導入コスト vs セキュリティレベルのマトリクス

セキュリティレベルと月額コストの関係を整理すると、以下の構図が見えてきます。

| ツール・プラン | 月額/人 | データ学習 | セキュリティ総合評価 |

|---|---|---|---|

| Claude Pro | $20(約3,000円) | 学習に使わない | 高い(全プランで一貫) |

| Claude Max 20x | $200(約30,000円) | 学習に使わない | 高い |

| ChatGPT Team | $25/人 | 学習に使わない | 高い(Team以上で適用) |

| Copilot for M365 | 約4,497円/人 | 学習に使わない | 高い(M365限定) |

| Gemini Business | $14/人 | Workspace版は学習に使わない | 高い |

| 各ツール無料版 | $0 | 学習に使われる可能性あり | 低い |

05 ACTION CHECKLIST 企業が今すぐやるべきセキュリティ対策チェックリスト AIツール導入前・導入後に確認すべき15項目

ここからは実践編です。AIツール(Copilot・ChatGPT・Claude・Geminiを問わず)を企業で導入する際に、最低限確認・実施すべきセキュリティ対策を15項目のチェックリストにまとめました。

5-1. 導入前のチェック項目(7項目)

5-2. 導入後の運用チェック項目(8項目)

このチェックリストの15項目を一度に完璧にする必要はありません。まずは上位3項目(データ学習ポリシー確認・プラン限定・禁止データの定義)から始めて、四半期ごとに残りの項目を段階的に整備していくのが現実的です。

06 GUIDELINE CREATION 社内AIガイドライン策定の実践ステップ 「ルールがないから使えない」を「ルールがあるから安全に使える」に変える

前章のチェックリストで「社内ルールを作る必要がある」と気づいた方へ。ここでは、中小企業でも2週間で策定できる社内AIガイドラインの作り方をステップバイステップで解説します。

6-1. ガイドラインに盛り込む5つの必須項目

| 項目 | 内容 | 具体例 |

|---|---|---|

| 利用目的の定義 | 何のためにAIを使ってよいか | 業務効率化・資料作成・リサーチは可、私的利用は不可 |

| 禁止データの一覧 | AIに入力してはいけないデータ | 個人情報・ソースコード・NDA対象情報・人事情報・未公開財務データ |

| 承認済みツール・プラン | 会社が公式に許可するAIツール | 例:Claude Pro以上、Copilot for M365のみ。無料版・個人版は不可 |

| 出力の取り扱いルール | AIの出力をどう使ってよいか | 外部送信前に必ず人間がレビュー、著作権チェック、ファクトチェック |

| インシデント対応 | 漏えい発生時の手順 | 発見者→情報システム部→経営層の報告フロー、72時間以内の調査完了 |

6-2. 策定スケジュール(2週間モデル)

現状調査

どのAIを

誰が使っているか

ドラフト作成

5項目を

文書化

レビュー

経営層+法務

の確認

全社展開

研修+配布

運用開始

大企業のようにISMS認証に紐づいた厳格なプロセスを踏む必要はありません。「まず文書化して全社に配る」ことが重要であり、完璧さを追求して策定が遅れる方が危険です。

6-3. ガイドライン文書のテンプレート構成

実際のガイドライン文書は、以下の構成で作成すると抜け漏れが少なくなります。

実は、社内AIガイドラインの素案作成自体をClaude Codeに依頼できます。「当社は従業員30名のIT企業です。社内AIガイドラインの素案を作ってください」と指示すれば、業界特性を考慮した素案が数分で出力されます。それをベースに自社の実態に合わせてカスタマイズすれば、策定工数を大幅に短縮できます。

07 GENAI CASE STUDY 【独自データ】GENAIが選んだセキュリティ重視のAI運用体制 弊社がCopilotでもChatGPTでもなくClaude Codeを選んだ理由

ここでは、弊社(株式会社GENAI)がなぜCopilotでもChatGPTでもなくClaude Codeを主力AIツールとして選定したのかを、セキュリティの観点から解説します。

7-1. 弊社のAIツール選定基準

弊社では、AIツールの選定にあたって以下の3つの基準を重視しました。

| 基準 | 重み | 判断内容 |

|---|---|---|

| データ学習ポリシーの明確さ | 最重要 | 入力データがAI学習に使われないことが契約上保証されているか |

| 業務全般への適用力 | 重要 | 営業・経理・広告・開発まで横断的に使えるか |

| コストパフォーマンス | 重要 | 1人あたりの月額と得られる業務削減効果のバランス |

この3基準で評価した結果、Claude(Max 20xプラン)が全基準で最も高い評価となりました。

7-2. Claude Codeを選んだ3つの決め手

決め手1:全プランで「データを学習に使わない」明確なポリシー

Claudeは無料版を含む全プランで、ユーザーの入力データをAIモデルの学習に使わないことを明言しています。ChatGPTやCopilotのように「有料版なら学習に使わない」という条件付きではなく、ポリシーが一貫している安心感がありました。

決め手2:Claude Codeによる業務自動化の幅広さ

Claude Codeはターミナル上でファイル操作・コード実行・複数ステップの自動化ができるエージェント型AIです。弊社では営業資料作成、ブログ記事執筆、広告レポート生成、経理処理、秘書業務まで全社の業務を1つのツールでカバーしています。

決め手3:Max 20xプランのコストパフォーマンス

月額$200(約30,000円)で、Proプランの約20倍の使用量を確保できます。弊社では全社の業務をClaude Codeに絡ませており、月間160時間相当(1名分のフルタイム業務量)を分担している肌感です。人件費換算で月20〜25万円分の業務価値を、月3万円で実現しています。

7-3. 弊社の業務領域別Claude Code活用実績

| 業務領域 | 主な用途 | 概算削減時間 |

|---|---|---|

| 営業 | 提案書・見積・顧客別資料の自動生成 | 週20h → 週2h |

| 広告運用 | 週次レポート・CPA分析・配信調整 | 週10h → 週1h |

| ブログ記事 | SEO記事執筆・リライト・内部リンク最適化 | 1本8h → 1本1h |

| 経理 | 請求書チェック・経費仕訳・Freee連携 | 月40h → 月5h |

| 秘書業務 | 日報生成・議事録・スケジュール調整 | 日2h → 日15分 |

上記の削減時間は弊社の主観的な目安であり、業種・業態・担当者のスキルによって大きく変動します。あくまで「Max 20xプランでどの程度使い込めるか」の参考値としてお読みください。

08 CLAUDE SECURITY Claude Codeが「データを学習に使わない」と言い切れる理由 Anthropicのデータポリシーを技術的に理解する

前章で「Claudeは全プランでデータを学習に使わない」と書きましたが、「本当にそうなの?」と疑問に思う方も多いでしょう。ここでは、Anthropicがどのような技術的・契約的根拠でこのポリシーを担保しているのかを解説します。

8-1. Anthropicの公式データポリシー

Anthropicは公式に以下のポリシーを明言しています。

📚 用語解説

Anthropic:Claude AIを開発するAI企業。元OpenAIの研究者が2021年に設立。「安全なAI開発」を企業ミッションに掲げ、AI安全性研究とセキュリティポリシーの透明性で業界をリードしています。Googleが約$20億を出資するなど、大手からの信頼も厚い企業です。

8-2. ChatGPT・Copilotとの決定的な違い

ChatGPT(OpenAI)の場合、無料版・Plus版はデフォルトで学習に使用されます。オプトアウト(学習利用の停止)は設定画面から可能ですが、多くのユーザーはこの設定の存在を知らないまま利用しています。Team・Enterpriseプランでは学習に使わないポリシーが適用されますが、「高いプランを払わないと学習に使われる」構造です。

Copilot(Microsoft)も同様で、Copilot for Microsoft 365という法人向けプランでのみ商用データ保護が適用されます。無料版やCopilot Proでは、データが学習に使われるリスクが残ります。

対してClaudeは、無料版を含む全プラン・全利用形態で「学習に使わない」が基本ポリシーです。この一貫性が、セキュリティを重視する企業にとっての安心材料になっています。

| ポリシー | Claude | ChatGPT | Copilot |

|---|---|---|---|

| 無料版で学習に使わない | 基本的にYES | NO(デフォルト学習) | NO(学習リスクあり) |

| 有料個人版で学習に使わない | YES | 設定でオプトアウト可 | リスク残存 |

| 法人版で学習に使わない | YES | YES(Team以上) | YES(for M365) |

| ポリシーの一貫性 | 全プランで統一 | プランにより異なる | プランにより異なる |

8-3. Claude Code特有のセキュリティ設計

Claude Codeは通常のClaude(チャット版)とは異なり、ユーザーのローカル環境で動作するエージェント型AIです。この構造自体がセキュリティ面での優位性を生み出しています。

1. 入力データをAI学習に使わない(全プランで保証)

2. 必要最小限のデータのみをサーバーに送信

3. SOC 2 Type II認証による第三者検証済み

これらが組み合わさることで、機密データを扱う業務でもセキュリティリスクを最小化できます。

09 CONCLUSION まとめ ── AIセキュリティは「ツール選び」で8割決まる 情報漏えいを恐れてAIを使わないリスクの方が大きい時代

この記事では、Microsoft Copilotの情報漏えいリスクを起点に、主要AIツール4社のセキュリティポリシー比較、企業が取るべき具体的な対策、社内ガイドラインの策定方法までを解説しました。最後にポイントを振り返ります。

最も重要なメッセージをお伝えします。「情報漏えいが怖いからAIを使わない」という判断は、2026年の経営環境では最もリスクの高い選択肢になりつつあります。競合他社がAIで業務効率を上げている中で、自社だけAIを使わないことは「緩やかな競争力の喪失」を意味するからです。

正しい対応は、「AIを使わない」のではなく、「安全なツールを選び、正しいルールの下で使う」ことです。この記事で整理したセキュリティポリシー比較と対策チェックリストが、あなたのAI導入判断の助けになれば幸いです。

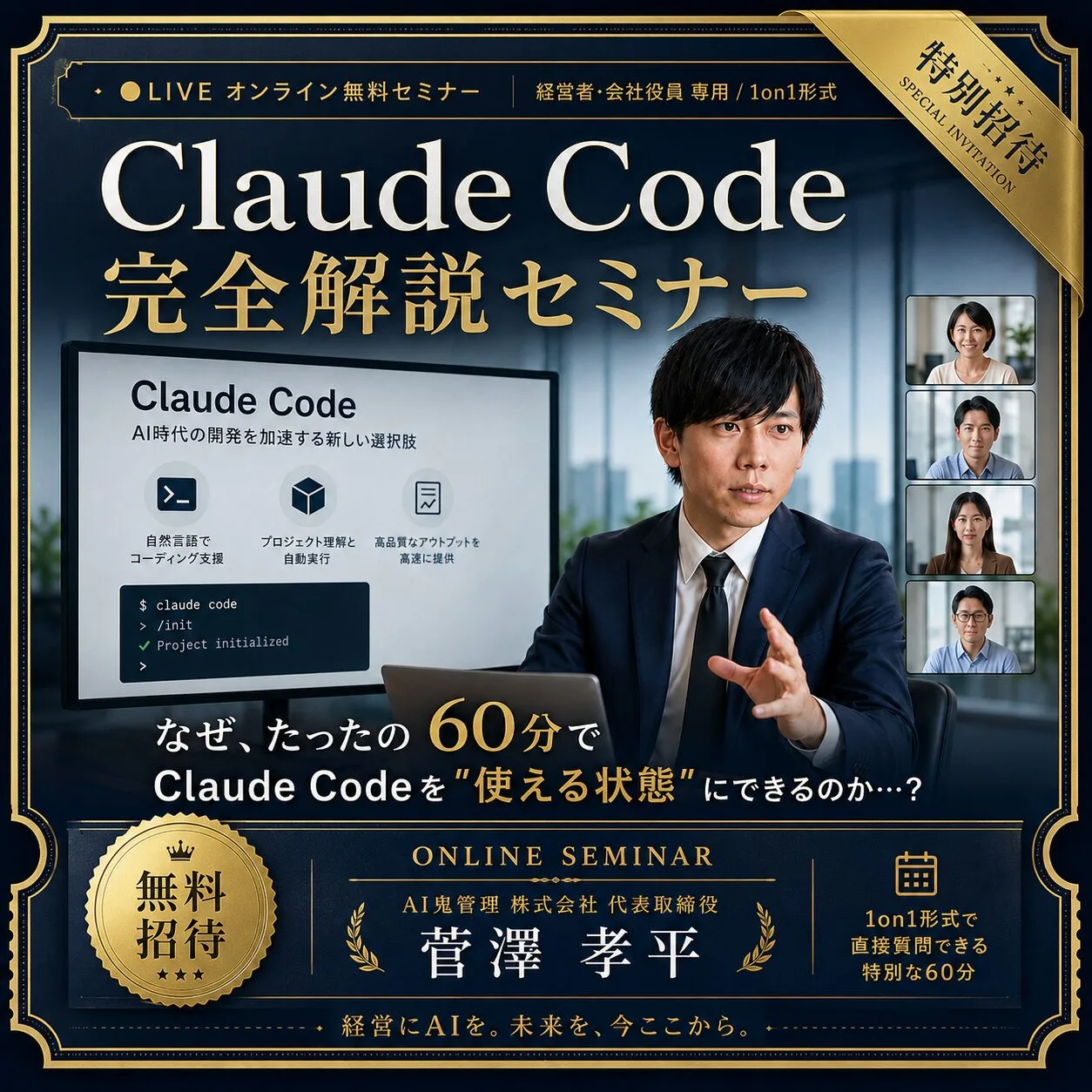

セキュリティ重視でAIを導入したい方へ ── AI鬼管理がサポートします

「AIを使いたいが情報漏えいが怖い」「社内ガイドラインを作る余裕がない」——そんなお悩みを、弊社の実運用ノウハウで解決します。

Claude Codeの導入設計から社内ルール策定まで、セキュリティと業務効率化を両立する運用体制を一緒に構築しましょう。

NEXT STEP

この記事の内容を、あなたのビジネスで

実践してみませんか?

AI活用を自社で回せるようになりたい方

AI鬼管理

Claude CodeやCoworkの導入支援から、業務設計・ルール作成・社内浸透まで実践ベースで伴走します。「自分たちで回せる組織」を作りたい経営者向け。

学ぶ時間はない、とにかく結果がほしい方

爆速自動化スグツクル

業務ヒアリングから設計・開発・納品まで丸投げOK。ホームページ、LP、業務自動化ツールを最短即日で構築します。

| AI鬼管理 | 爆速自動化スグツクル | |

|---|---|---|

| こんな方向け | 社内で回せる状態を作りたい 外注に依存しない組織を作りたい | 学ばなくていいから結果だけ欲しい とにかく早く自動化したい |

| 内容 | AIの使い方・業務設計・自動化の作り方を 実践ベースで叩き込む | 業務をヒアリングし、設計から ツール・システムを丸ごと納品 |

| 一言で言うと | 自分で作れるようになる | 全部任せられる |

| AI鬼管理を詳しく見る | スグツクルを詳しく見る |

よくある質問

Q. Microsoft Copilotの無料版を社員が使っている場合、すぐにやめさせるべきですか?

A. はい、機密情報を扱う業務では即座に利用を停止すべきです。無料版CopilotはCommercial Data Protection(商用データ保護)が適用されないため、入力データがAIの学習に使われる可能性があります。代替として、Copilot for Microsoft 365(月額4,497円/人)への移行か、Claude Pro(月額$20)など全プランで学習に使わないツールへの切り替えを推奨します。

Q. ChatGPTのオプトアウト設定(学習停止)をすれば安全ですか?

A. オプトアウト設定をすれば、その時点以降の入力データは学習に使われなくなります。ただし、過去に入力済みのデータは既に学習されている可能性があります。また、オプトアウトは個人設定のため、チームメンバー全員が設定しているか管理する手間が発生します。組織的に安全を担保するなら、そもそも学習に使わないポリシーのツール(Claude)を選ぶ方が確実です。

Q. Copilot for Microsoft 365は本当に安全と言い切れますか?

A. Commercial Data Protectionが適用され、契約上「入力データをAI学習に使わない」ことが保証されているため、データ学習のリスクは極めて低いです。ただし、ソフトウェアバグによる予期しないデータ露出(2023年のOpenAI事例のような)のリスクはゼロにはなりません。100%の安全を保証できるAIツールは存在しないため、ツール側の対策と社内ルールの整備を併用することが重要です。

Q. Claude Codeは本当にデータを学習に使わないのですか?根拠はありますか?

A. Anthropicの公式利用規約およびプライバシーポリシーで、APIおよびClaude.ai経由の入力データをモデル学習に使わないことが明記されています。さらに、SOC 2 Type II認証を取得しており、第三者監査機関がデータ管理体制を検証しています。ただし、ユーザーが明示的にフィードバックとして送信した場合を除きます。法的拘束力のある契約と第三者監査の二重保証がある点が、他ツールとの違いです。

Q. AI経由で情報漏えいが起きた場合、法的責任は誰にありますか?

A. AIツールの利用規約上、多くのベンダーはデータ漏えいに対する責任を限定的にしか負いません。つまり、社員が機密情報をAIに入力して漏えいが起きた場合、法的責任は主に利用企業側に帰属します。だからこそ、社内AIガイドラインの策定と社員教育が不可欠です。「ベンダーが守ってくれるから大丈夫」ではなく、「自社で管理する」姿勢が必要です。

Q. 中小企業でも社内AIガイドラインを作るべきですか?大企業向けでは?

A. 従業員数に関係なく、AIを業務で使うなら最低限のガイドラインは必要です。中小企業の場合、大企業のような100ページの規定書は不要で、A4で2-3ページの簡潔なルール(承認ツール・禁止データ・インシデント対応の3項目)で十分です。弊社のガイドラインも実質3ページです。記事内で紹介した2週間策定モデルを参考に、まず文書化することから始めてください。

Q. AIツールのセキュリティ以前に、そもそもAI導入が必要ですか?

A. 2026年時点では、AIを業務に導入しないこと自体がビジネスリスクになりつつあります。競合他社がAIで業務効率化を進める中、自社だけ手作業を続けていれば、コスト競争力とスピードで劣後していきます。重要なのは「AIを導入するかどうか」ではなく、「どのAIを、どのように安全に導入するか」です。この記事で紹介した対策を参考に、安全なAI活用を始めてください。

| AI鬼管理 | 爆速自動化スグツクル | |

|---|---|---|

| こんな方向け | 社内で回せる状態を作りたい 外注に依存しない組織を作りたい | 学ばなくていいから結果だけ欲しい とにかく早く自動化したい |

| 内容 | AIの使い方・業務設計・自動化の作り方を 実践ベースで叩き込む | 業務をヒアリングし、設計から ツール・システムを丸ごと納品 |

| 一言で言うと | 自分で作れるようになる | 全部任せられる |

| AI鬼管理を詳しく見る | スグツクルを詳しく見る |

📒 NOTE で深掘り

AI鬼管理 × 経営者の本音は note でも発信中

ブログでは伝えきれない経営者目線の体験談・業界動向・社内エピソードを

note にて公開しています。フォローして最新情報をチェック!

Claude Codeで業務自動化を90日で叩き込む

経営者向けの伴走型パーソナルトレーニング

Claude Code を業務に落とし込む

専門研修コース一覧

受講者本人の業務を題材に、「使いこなせる」状態になるまで伴走する研修プログラム。1対1特化型・ハンズオン・法人講座の3コースを展開中。業務特化・実装まで踏み込むタイプのClaude Code研修です。

研修コース一覧を見る →AI鬼管理へのお問い合わせ

この記事を読んで気になった方へ。

AI鬼管理の専門スタッフが、御社に最適な

業務自動化プランを無料でご提案します。